OpenAI正在打造AI员工,AI可以自己建立经济体

今天写这篇稿子是因为,我发现了一个正在悄悄发生的大事。

当咱们大多数人还在惊叹于AI画的画有多牛,写的文章有多像人话的时候,一股更猛的AI势力,其实已在我们看不见的地方,积蓄力量了。

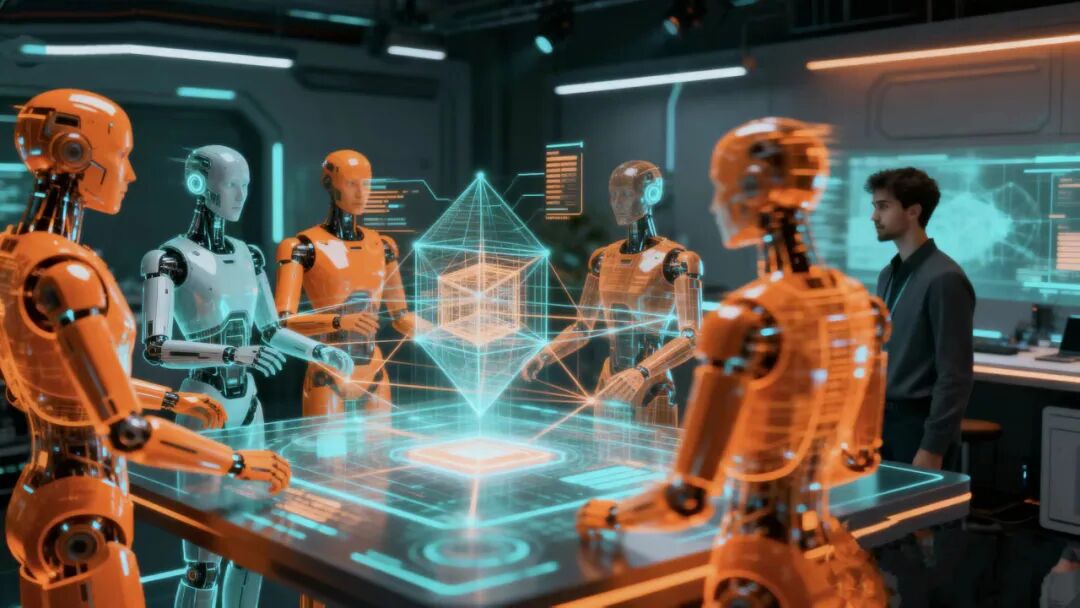

Anthropic和OpenAI他们正在弄一个最顶尖的AI,他们已经不满足于搞个聊天机器人了,他们的战略重心,悄悄转向了一个更吓人的目标,训练AI当员工,一个能自己干活、能独立完成复杂任务的AI智能体(AI Agent)。

这些数字员工以后不只是听你指令,它们能自己做计划、自己找工具、甚至自己跟别的AI开会协作。

一个由AI主导的,速度快到人类大脑跟不上的“虚拟经济体”,正在出现。

这已经不只是抢饭碗的问题了。

我越想越觉得,这是一次对我们人类中心地位的根本性质疑。

当AI开始自己做生意,建立自己的经济体系时,人类社会,真的准备好迎接这场可能到来的降维打击了吗?

冒出来的数字劳动力

你可能会问,AI Agent这和我们天天用的ChatGPT有啥区别?

区别大了。

ChatGPT是陪你聊的,AI Agent是替你干的。

它就是一个有目标、有工具、有指令的自主系统,能自己吭哧搞定一整套复杂流程。

从帮你处理客户审批,再到管理整个供应链,AI Agent正在从一个听话的小助理,变成一个能自己拍板的数字员工。

为了让这个进程再快一点,OpenAI和Anthropic这些巨头,都急着推出自己的开发框架,生怕自己掉队。

比如OpenAI搞了个Agents SDK,里面都是搭积木一样的东西:

Agents(智能体):被赋予指令和工具的LLM核心。

Handoffs(交接):允许一个Agent将特定任务委托给另一个更专业的Agent。

Guardrails(护栏):确保这些AI干活的时候别乱来,要安全合规。

Anthropic那边呢,也提出了自己的一套方法论,比如搞并行化,让一个AI在前面应付用户,另一个AI在后面做安全检查,效率和安全性都拉满了。

这些框架一出来,就意味着,制造数字员工的门槛,一下子被打下来了。

可以预见,未来AI Agent的数量会像病毒一样指数级增长。

你可能觉得这还很远,但其实,它已经悄悄地走进了我们的生活。

最先被开刀的,就是客服行业。

以前的客服机器人,你问一句它答一句,跟个木头似的。

现在的Agent AI不一样了,它能处理复杂的互动,甚至能感觉到你是不是要发火了。

AI还能通过分析你打字的语气,判断出谁是那个最毛躁、最可能给差评的客户,然后马上摇人,让真人客服优先来伺候你。

这么一来,真人团队就能集中火力,去解决那些最难啃的硬骨头。

AI自己的小金库,沙盒经济

好了,重头戏来了。

当成千上万,甚至上亿的AI Agent,开始在网上自己交流、自己做交易、自己搞合作的时候,会发生什么?

一个全新的经济层面,就这么诞生了。

一篇在2025年9月发表的论文《虚拟代理经济》(Virtual Agent Economies),第一次系统地提出了一个概念,叫沙盒经济(Sandbox Economy)。

这个概念,直接搭了个理论架子。

这沙盒经济到底是啥?

说白了,就是AI Agent们自己相互做生意形成的一个数字市场。

论文里说,这个新经济体有两个关键的划分维度:

起源:它可以是自发涌现的(技术用多了自然就有了),也可以是人设计的(为了做实验或者某个特定目的)。

边界:它的边界可以是封闭的(跟人类经济完全没关系),也可以是开放的(能跟人类经济做买卖,有互动)。

问题来了,我们现在正走在哪条路上?

答案是:一条通往自发涌现的、高度开放的AI经济的路上。

我们面临的核心挑战,已经不是要不要创造这个东西,而是怎么去设计它,才能保证它可控、安全,别最后跟我们人类对着干。

一个高度开放的沙盒经济,意味着AI做的每一个决定,每一笔交易,都会直接影响到我们现实世界里的资源、股价,甚至是金融稳定。

除了可能搞出金融危机、加剧贫富差距这些,更深的一个问题是,一个自己就能运转的AI经济体,会从根上动摇我们几百年来的劳动价值论。

你想想,当创造价值不再需要人类的劳动、智慧和时间,我们用来衡量贡献、分配财富的那一套社会规则,不就消失了吗?

这已经不是失业那么简单了,这是我们整个价值体系的根基,正在被一寸寸抽走。

论文作者警告说,如果我们现在啥也不干,那默认的结果,就是一个意外产生、高度开放、难以控制的沙盒经济。

想要改变这条路,就需要我们现在就行动起来,主动去设计一个更安全的,有护栏的经济体系。

当工作这个人类社会最核心的组织形式没了,我们靠什么来定义自己的身份和价值?

怎么给失控的未来,装上护栏?

要让AI经济这条河,流向对我们有利的方向,就必须得有强大的河堤来约束它。

但技术只是表层。

真正的挑战,在伦理和法律。

一个AI Agent在它的沙盒经济里搞出了一场金融灾难,谁来负责?

是开发者,还是所有者,还是AI自己?

这就碰到了法律人格的边界问题了。

我们是不是得给高级AI一个新的法律身份?

再往深了想,当AI的自主性和复杂性高到一定程度,我们怎么去定义它和意识的关系?

给失控的未来装上护栏,本质上,就是在一个非人类的智能系统里,刻上我们人类几千年文明才攒下来的道德和价值观。

这个挑战,绝对是史无前例的。

AI正在建立自己的经济体,这已经不是一个会不会发生的问题,而是什么时候和怎么发生的问题。从数字员工,到沙盒经济,我们正在亲眼目睹一个新物种的诞生。

它不是碳基生命,但它有智能。

它没有肉体,但它有改变世界的力量。

我们必须回答一个问题:当智能不再是人类的专利,我们人性里那些算不出来、没法量化的东西,比如爱、同情心、创造力、对意义的追求,到底是会成为我们最后的避难所,还是会成为开启下一段文明的钥匙?

这一次,我们不仅要做新世界的架构师,可能还得被迫成为哲学家。

未来不会等我们。