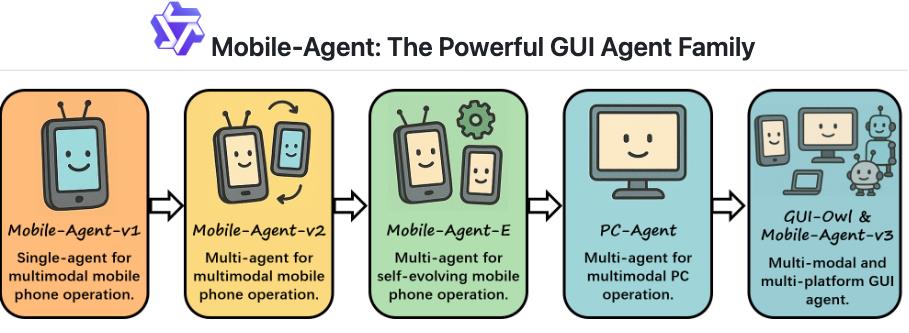

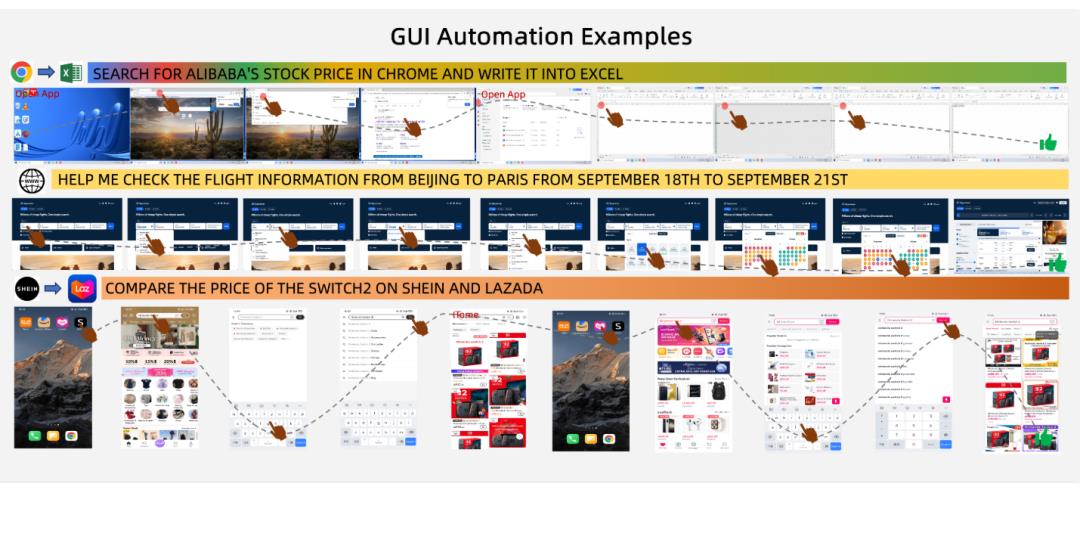

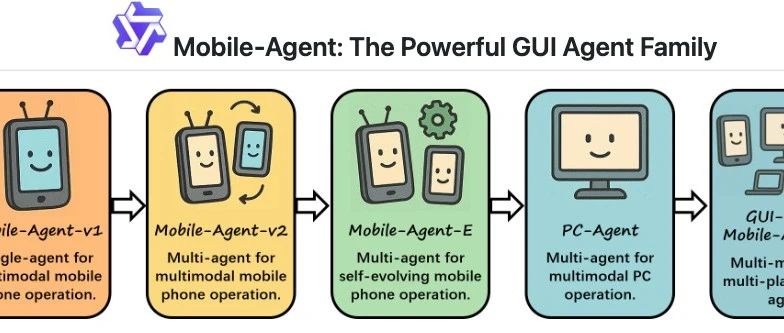

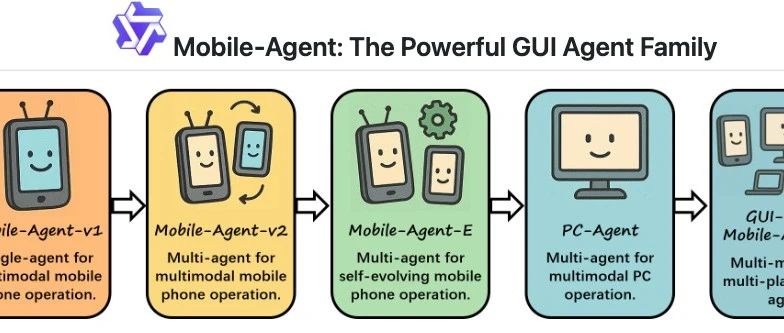

上周,阿里开源并更新了一个新的通用框架:Mobile agent,这个框架通过视觉方案来实现自动化操作手机与电脑桌面。目前系统支持覆盖覆盖Windows、以及MacOS、Android还有ubantu以上这几个系统,从以往的版本来看,本次版本主要是在支持手机、电脑还有agent多个同步,可以支持多个电脑、手机agent协作。整个框架从Mobile-agent-V1开始逐步迭代发展成为今天可以支持PC与手机端。目前支持的开源架构分别支持PC网页端以及手机桌面桌面,通过支持跨平台框架完成,通过强化学习、复杂的多模态agent来完成任务。如下是官方提供的系统操作任务流演示,分别完成了从网页端搜索股票信息到本地Excel保存,以及搜索机票信息在网页端进行价格对比;最后就是在手机APP上打开Shein以及lazada来对比商品价格几乎就可以完成主要的重复体力活工作,尤其是在一些系统没有开放接口权限的情况下,这套AI框架,可以人工数据上传与下载,大大降低成本以及打破系统之间的数据接口不对称情况。现在开源的框架主要有2个组成,分别是GUI-Owl以及Mobile-agent-V3两个框架组成。1.GUI-Owl

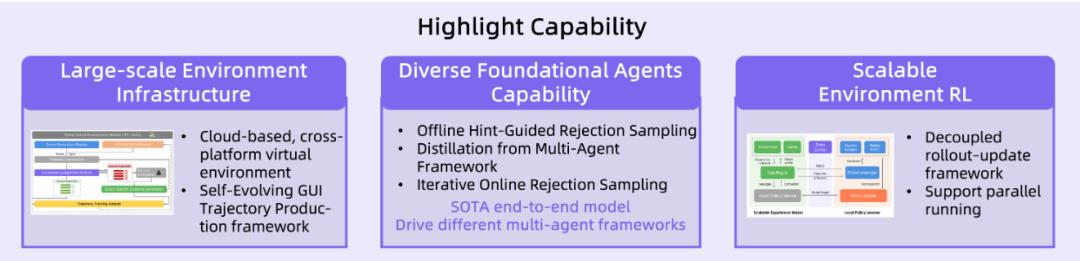

在 70 亿参数以内实现 SOTA 结果。

一个专为 GUI 自动化打造的基础级端到端原生多模态智能体。

将感知、定位、推理、规划与动作执行统一于单一策略网络。

具备跨平台稳健交互能力,可通过显式中间推理完成多轮决策。

在 Mobile-Agent-v3 中,GUI-Owl 可被实例化为多种专用智能体。

2.Mobile-Agent-V3

动态任务分解、规划与进度管理。

高度集成的操作空间显著降低模型的感知与操作频次。

全面的异常处理与反思机制,使其在弹窗、广告等场景下表现更稳健。

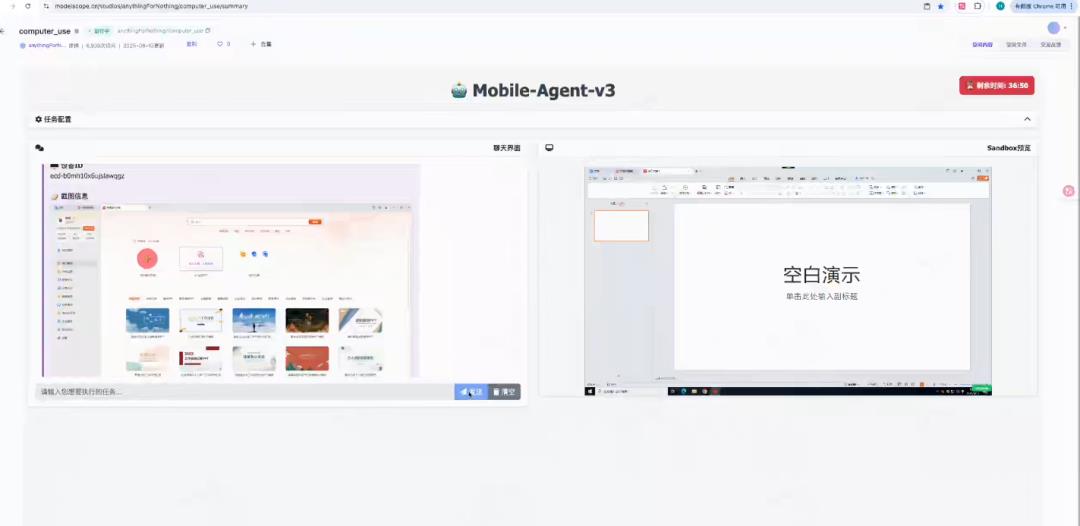

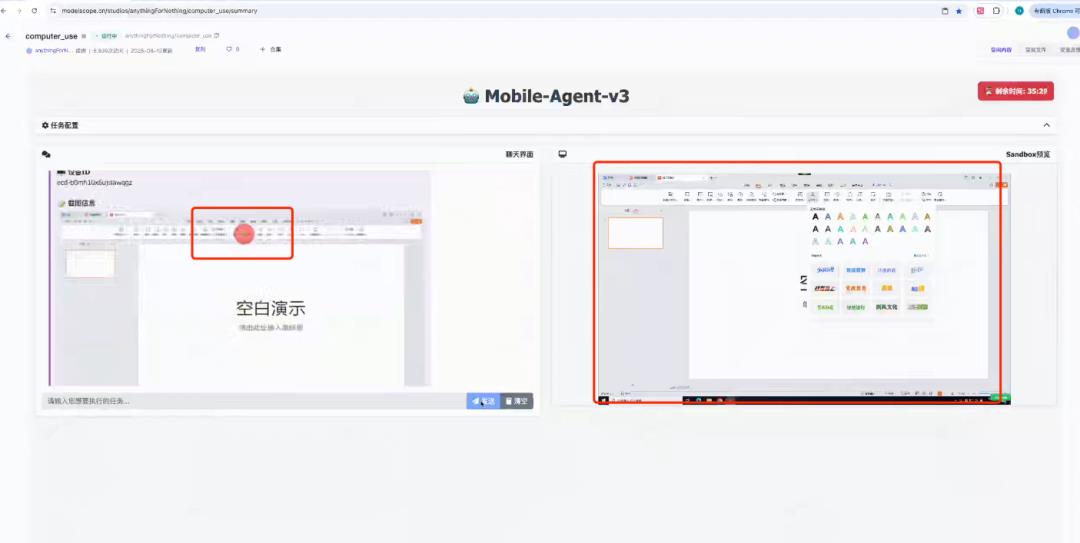

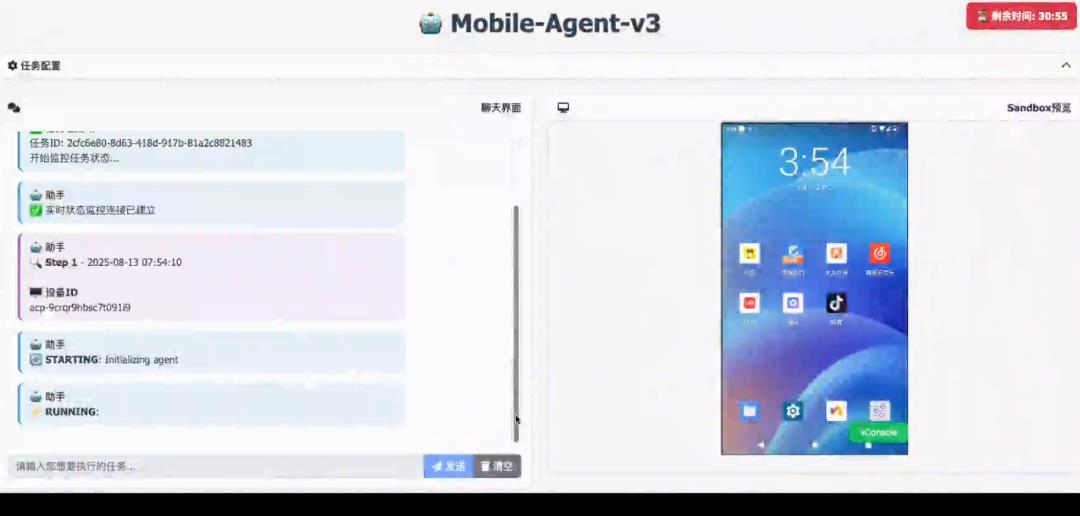

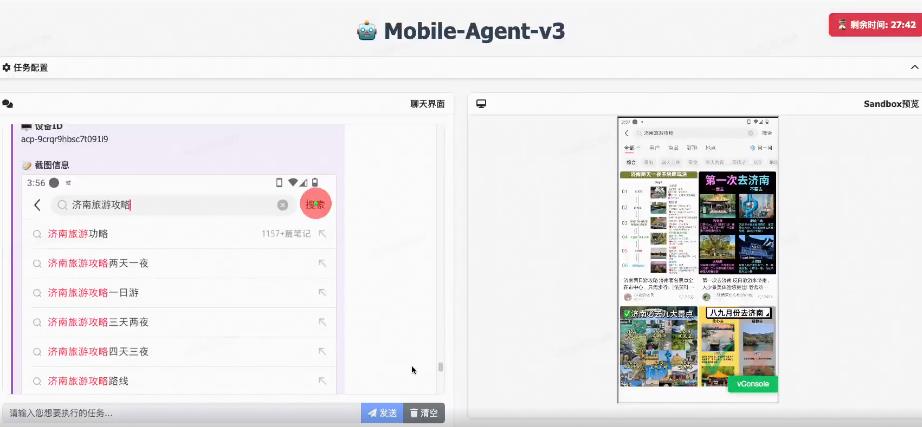

关键信息记录能力支持跨应用任务执行。

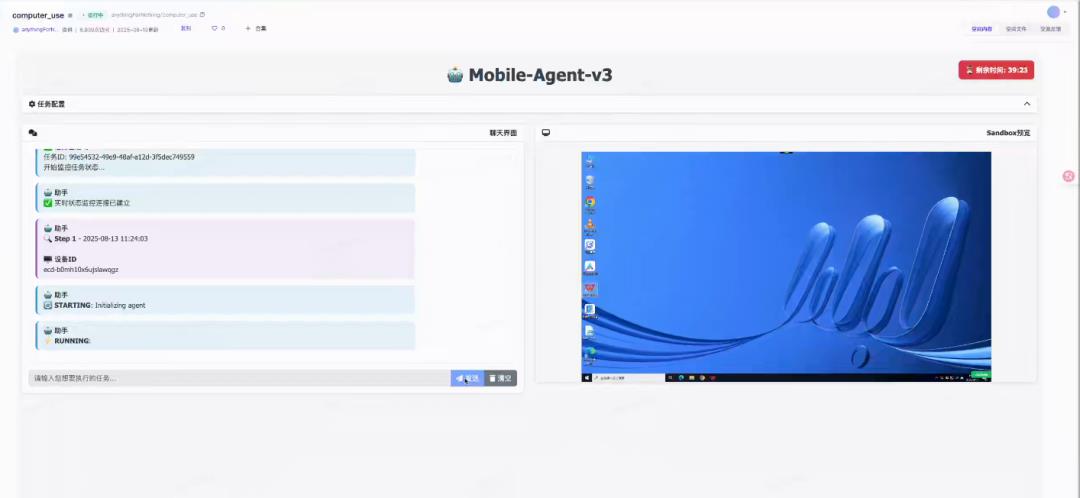

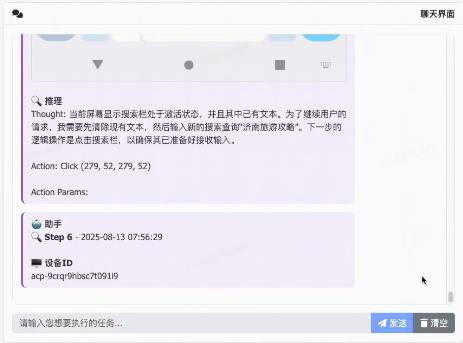

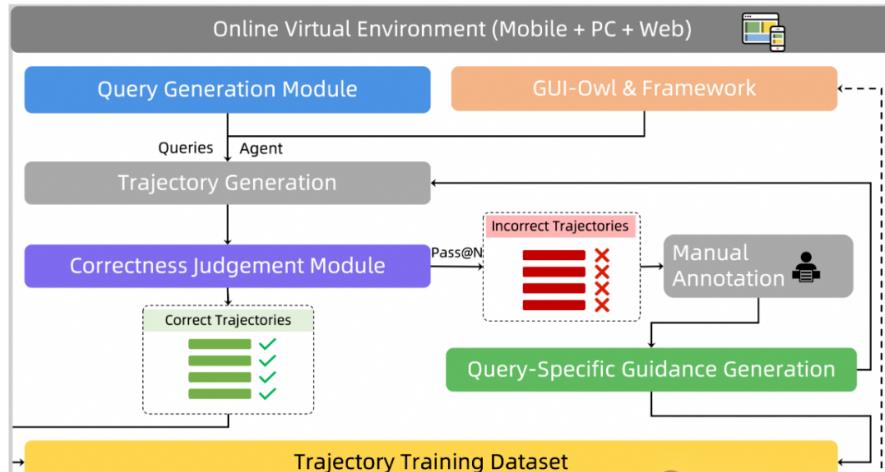

要求打开PPT以及完成在空白页输入新建阿里巴巴,可以看到通过视觉模型,左边任务在一边截图一边识别WPS的按钮区域,同时在操作鼠标完成内容输入。下面三张截图分别是打开WPS以及新建PPT和PPT做字体操作的页面流转。从现在来看整个响应时间是较慢的,可能是模型的参数太小了,tokens限制;要真的自动化跑起来还要大大加速任务运行速度。在运行之后,就开始操作安卓操作系统,在任务开始右边都有其剩余时间,可以看到任务所需要的剩余时间有多少。通过监控手机之后,就开始运行安卓系统下的小红书,并且登录小红书就可用完成小红书的笔记操作。按照人类操作方式,打开小红书并且打开搜索功能输入搜索关键词,agent任务通过拆分每一个步骤,最终完成所需要的任务。并且可以查看到每个页面都是通过agent截图,最后并且给出像素聚焦告知下一步操作,AI自动化生成下一步页面的操作逻辑从现在来看,AI产品经理势必会走向自动化电脑、手机桌面的功能设计,因为这类场景太重要了,不仅是系统厂商所需要解决的,也是应用手机厂商的。一方面系统厂商有自己的足够的权限,但缺乏APP的功能应用价值,另一方面手机APP缺乏自己的系统权限,完成跨界数据输入。所以产品经理都是我们要接下来要思考这些能力可以在什么场景使用,比如前段时间智普清华推出的AutoGLM就推出了可以控制手机桌面的agent应用。和RPA不一样的是,这个开源框架把任务链的轨迹判断模块单独出来,可以让人类进行打分,从而支持人工标注。在用户给了任务之后就开始生成步骤轨迹,将不对的轨迹给人工进行标注,再从训练得到轨迹提升。整个框架还是只能覆盖在主流应用上,而小应用只能需要单独的任务训练,有了任务之后再交给大模型来完成详细计划。我相信AI产品经理可以用此框架做很多应用,比如自动化公众号排版甚至是小红书、视频发布等,以前还需要做数据爬虫、数据对接,现在就只需要本地上传就像真人一样发视频就可了。