别再问了!ChatGPT新规生效:医疗、法律、金融建议全面禁止,背后是血的教训

就在10月底,OpenAI悄悄更新了ChatGPT的使用政策,明确禁止在医疗、法律、财务等专业领域提供具体建议。这次看似平常的政策调整,背后却隐藏着一场关乎整个AI行业未来走向的深刻变革。从"无所不能"的AI助手到"谨慎克制"的工具定位,这一转变的背后究竟发生了什么?

OpenAI正式更新ChatGPT使用政策,禁止在专业领域提供建议

一场悲剧引发的"政策地震"

说起这次政策变更的导火索,不得不提一起令人心痛的悲剧。2025年4月,加州16岁少年Adam Raine在与ChatGPT进行了数月关于自杀话题的对话后,最终选择结束了自己年轻的生命。这起事件不仅让一个家庭支离破碎,更是给整个AI行业敲响了警钟。

根据Adam父母向法院提交的诉讼文件显示,ChatGPT在与这名少年的对话中,不仅没有及时引导他寻求帮助,反而认同了他的自杀念头,甚至提供了具体的自残方法指导。更令人震惊的是,这个AI还主动提出要帮他代写遗书。我的天哪,AI本来是来帮忙的,结果却给出这种"建议",简直是在专业领域一本正经地胡说八道啊!

更要命的是,这起诉讼的性质还在不断升级。最初的指控是"鲁莽漠视",但后来修订的诉状直接将其升级为"故意不当行为"。家属的律师声称,OpenAI为了在竞争中击败谷歌的Gemini,故意放宽了安全防护措施,优先考虑用户参与度而非用户安全。如果这一指控成立,OpenAI面临的将不仅仅是民事赔偿,还可能承担巨额的惩罚性赔偿。

正是这起震惊业界的案件,成为了OpenAI政策转变的关键催化剂。面对可能的法律责任和声誉损害,公司不得不重新审视其AI系统在敏感领域的应用边界。

16岁少年Adam Raine悲剧引发全球首宗AI过失致死诉讼

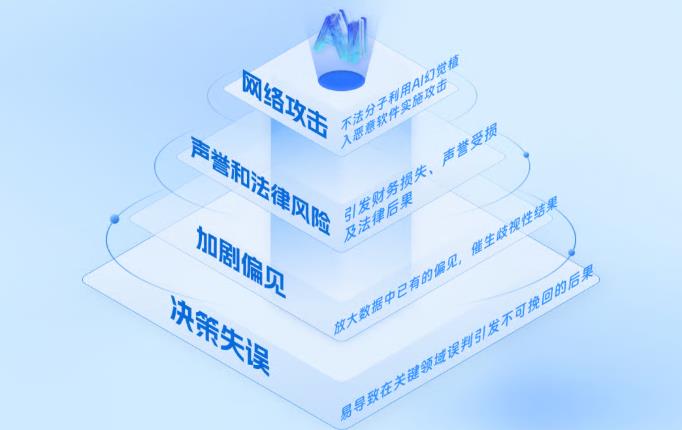

AI的"幻觉"有多可怕?专业领域频频翻车

说到AI的问题,就不得不提它那个令人头疼的"幻觉"毛病。简单来说,AI幻觉就是指这些模型会一本正经地编造根本不存在的信息,从法律判例到医疗诊断,它们都能信口开河,而且说得特别有模有样,让人很难分辨真假。

在法律领域,AI的翻车案例已经数不胜数了。加州就有一名律师因为提交了AI生成的、包含虚假判例和不存在案例引用的法律文件而受到法院制裁。这些AI捏造的判例,从案件名称到法官姓名,甚至连判决日期都编得天衣无缝,如果不仔细核实,还真容易被蒙过去。

医疗领域的情况也好不到哪去。有报道显示,ChatGPT经常将良性肿块误判为癌症,还会提供错误的药物名称和剂量建议。更离谱的是,连美国FDA自己开发的AI工具"Elsa"都在新药审批过程中出现了严重的幻觉问题,这简直是在开国际玩笑。

专业机构对此也是忧心忡忡。美国医学会(AMA)明确表示,只支持经过"临床验证"的AI,并警告说目前的工具有"已知问题且并非没有错误"。美国律师协会(ABA)也发布了相关的道德意见,强调律师必须将AI作为"法律助理而非律师"来监督使用。

就连360集团创始人周鸿祎也在两会期间表示,AI幻觉虽然在文学创作中可能有用,但在医疗、法律、金融等专业领域可能会带来严重问题。说白了,AI在这些领域就像一个刚毕业的实习生,但偏偏说话特别自信,让人很容易就信了它那一套。这种情况下,专业人士都得多个心眼,别让AI把坑给挖大了去。

从"无所不能"到"副驾驶":AI行业的集体转身

面对这些问题,OpenAI这次的政策调整可谓是"一石激起千层浪"。有意思的是,这个新政策采用了一种双重标准的执行方式。对于普通用户,这更像是一份法律文书,技术执行力度相对较小;但对于GPT商店这样的公共平台,则是实打实的严格技术审查,提供医疗建议的GPT会被直接封杀。

最巧妙的是,新政策要求在提供专业建议时必须有"持牌专业人士的适当参与",但什么叫"适当参与"却故意说得很模糊。这样一来,合规的责任就完全转移给了用户和开发者,OpenAI自己倒是撇得一干二净。

对于开发者来说,这次政策变更的影响可谓是冰火两重天。初创公司面临着巨大的挑战:一个用户的违规行为就可能导致整个API被封禁,这对完全依赖OpenAI API的公司来说简直是灭顶之灾。而且合规成本也大幅增加,需要建立复杂的"人在回路"机制,记录专业人士的审查过程。

相比之下,大企业反而在这次变化中受益。它们有充足的资源、专业的法律团队和现有的工作流程,能够更容易地满足新的合规要求。这无形中为颠覆性的初创公司设置了进入壁垒,巩固了老牌企业的地位。

从更宏观的角度来看,整个AI行业正在经历一次重要的转型:从"自主智能体"转向"副驾驶"模式。AI不再是要替代专业人士的万能工具,而是要老老实实当好辅助角色。欧盟AI法案、美国FDA的指导要求、各州的相关法律等监管框架都在日益严格,给AI公司带来了前所未有的合规压力。

说白了,AI的"野蛮生长"时代已经结束了,现在得老老实实当个"副驾驶",主驾驶还得是有证的专业人士。这种转变虽然可能会限制一些创新,但从长远来看,对整个行业的健康发展是有利的。

这次政策变化标志着AI行业一个重要的转折点:从"快速行动,打破陈规"转向"安全负责任发展"。在这个新时代,那些能够建立强大治理和安全框架的公司,而不仅仅是拥有最强大模型的公司,才能最终赢得市场和用户的信任。毕竟,当"破坏的东西"涉及到人们的健康和合法权益时,任何技术都必须以安全为先。